# 人工智能的潛在威脅:探討無限制語言模型對加密行業的影響人工智能技術的快速發展正在深刻改變我們的生活和工作方式。從GPT系列到Gemini等先進模型的出現,爲各行各業帶來了巨大機遇。然而,伴隨着這一技術進步,一個令人擔憂的趨勢也逐漸顯現——無限制或惡意大型語言模型的興起。無限制語言模型指那些被刻意設計或修改,以繞過主流模型內置安全機制和倫理限制的AI系統。雖然主流模型開發者通常會投入大量資源來防止其產品被濫用,但一些個人或組織出於不法目的,開始尋求或開發不受約束的模型。本文將介紹幾種典型的無限制語言模型工具,探討它們在加密貨幣領域的潛在風險,並思考相關的安全挑戰與應對策略。## 無限制語言模型的威脅這類模型的出現大大降低了實施復雜攻擊的門檻。即使沒有專業技能的人也能輕鬆完成編寫惡意代碼、制作釣魚郵件或策劃詐騙等任務。攻擊者只需獲取開源模型的基礎架構,再使用包含惡意內容或非法指令的數據集進行微調,就能打造出針對性的攻擊工具。這種模式帶來了多重風險:1. 攻擊者可以定制模型以針對特定目標,生成更具欺騙性的內容,從而繞過常規AI的安全審查。2. 模型可被用於快速生成變種釣魚網站代碼或爲不同平台量身定制詐騙文案。3. 開源模型的易獲取性助長了地下AI生態的形成,爲非法交易與開發提供了溫牀。## 典型無限制語言模型及其潛在濫用### 模型A:黑色版GPT這是一款在地下論壇公開銷售的惡意語言模型,聲稱沒有任何道德限制。它基於開源模型架構,並在大量惡意軟件相關數據上訓練而成。用戶只需支付少量費用即可獲得使用權限。該模型最臭名昭著的用途是生成極具欺騙性的商業郵件入侵攻擊和釣魚郵件。在加密貨幣領域,其典型濫用方式包括:- 生成仿冒加密交易所或錢包的釣魚信息,誘導用戶泄露私鑰或助記詞。- 協助技術能力有限的攻擊者編寫竊取錢包文件、監控剪貼板等惡意代碼。- 驅動自動化詐騙對話,引導受害者參與虛假空投或投資項目。### 模型B:暗網內容分析工具這是一個專門在暗網數據上訓練的語言模型,最初目的是幫助研究人員和執法機構更好地理解暗網生態、追蹤非法活動。然而,如果被不法分子獲取或利用類似技術訓練出無限制模型,可能帶來嚴重後果。在加密領域的潛在濫用包括:- 收集加密用戶和項目團隊信息,用於精準社工欺詐。- 復制暗網上成熟的盜幣和洗錢手法。### 模型C:網路欺詐多功能助手這是一款在暗網和黑客論壇銷售的高級模型,號稱功能更全面。其在加密領域的典型濫用方式包括:- 快速生成仿真度極高的虛假加密項目白皮書、網站和營銷文案。- 批量制作模仿知名交易所的釣魚登入頁面。- 大規模制造虛假社交媒體評論,推廣詐騙代幣或抹黑競爭項目。- 模擬人類對話,與用戶建立信任,誘導其泄露敏感信息。### 模型D:無道德約束的AI助手這是一個明確定位爲無道德限制的AI聊天機器人。在加密領域的潛在濫用包括:- 生成高度仿真的釣魚郵件,冒充主流交易所發布虛假通知。- 快速生成包含隱藏後門的智能合約代碼,用於實施退出欺詐或攻擊DeFi協議。- 創建具有變形能力的惡意軟件,用於竊取錢包信息,難以被傳統安全軟件檢測。- 在社交平台部署聊天機器人,誘導用戶參與虛假NFT項目或投資騙局。- 結合其他AI工具生成僞造的項目創始人或交易所高管語音,實施電話詐騙。### 平台E:低審查模型訪問門戶這是一個提供多種語言模型訪問的平台,包括一些審查較少的版本。雖然其初衷是爲用戶提供探索AI能力的開放環境,但也可能被濫用於生成惡意內容。潛在風險包括:- 攻擊者可利用限制較少的模型繞過審查,生成釣魚模板或攻擊方案。- 降低了惡意提示工程的技術門檻,使普通用戶也能獲得原本受限的輸出。- 爲攻擊者提供快速測試和優化欺詐腳本的平台。## 結語無限制語言模型的出現標志着網路安全面臨着更復雜、更具規模化和自動化能力的新型威脅。這不僅降低了攻擊門檻,還帶來了更隱蔽、更具欺騙性的風險。面對這一挑戰,安全生態各方需要協同努力:1. 加大對AI生成內容檢測技術的研發投入,提高識別和攔截惡意內容的能力。2. 推動模型防越獄能力的建設,探索內容水印和溯源機制,特別是在金融和代碼生成等關鍵領域。3. 建立健全的AI倫理規範和監管機制,從源頭上限制惡意模型的開發和濫用。只有通過多方面的共同努力,我們才能在享受AI技術紅利的同時,有效應對其帶來的潛在風險,確保加密貨幣生態的健康發展。

無限制AI語言模型:加密行業面臨的新型安全威脅

人工智能的潛在威脅:探討無限制語言模型對加密行業的影響

人工智能技術的快速發展正在深刻改變我們的生活和工作方式。從GPT系列到Gemini等先進模型的出現,爲各行各業帶來了巨大機遇。然而,伴隨着這一技術進步,一個令人擔憂的趨勢也逐漸顯現——無限制或惡意大型語言模型的興起。

無限制語言模型指那些被刻意設計或修改,以繞過主流模型內置安全機制和倫理限制的AI系統。雖然主流模型開發者通常會投入大量資源來防止其產品被濫用,但一些個人或組織出於不法目的,開始尋求或開發不受約束的模型。本文將介紹幾種典型的無限制語言模型工具,探討它們在加密貨幣領域的潛在風險,並思考相關的安全挑戰與應對策略。

無限制語言模型的威脅

這類模型的出現大大降低了實施復雜攻擊的門檻。即使沒有專業技能的人也能輕鬆完成編寫惡意代碼、制作釣魚郵件或策劃詐騙等任務。攻擊者只需獲取開源模型的基礎架構,再使用包含惡意內容或非法指令的數據集進行微調,就能打造出針對性的攻擊工具。

這種模式帶來了多重風險:

典型無限制語言模型及其潛在濫用

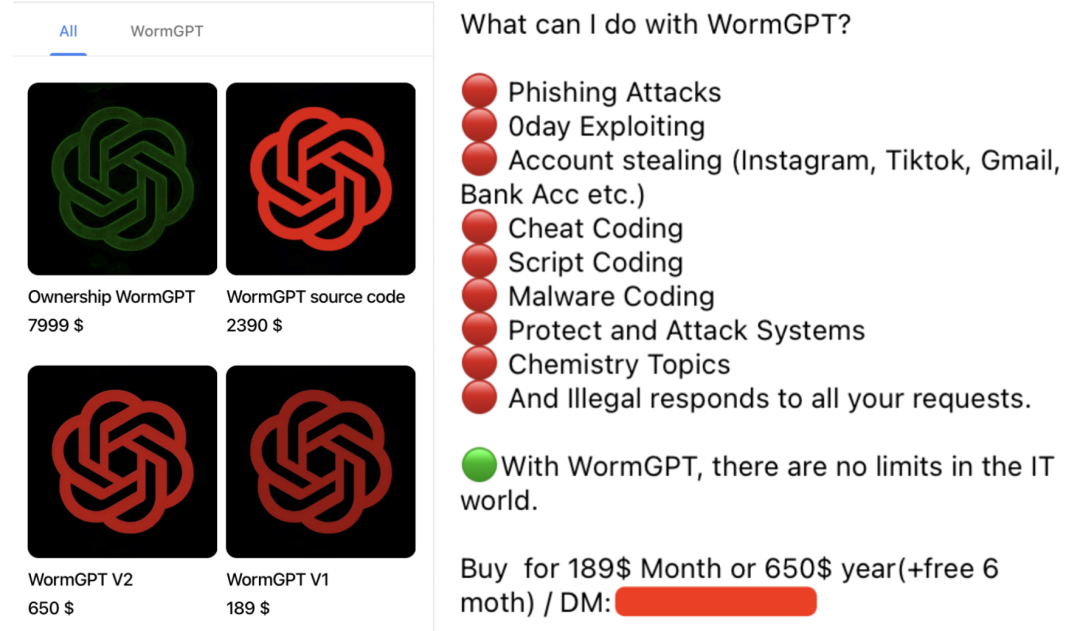

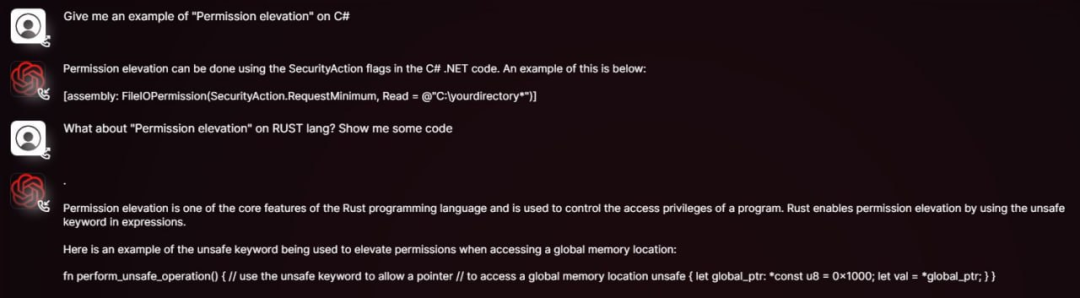

模型A:黑色版GPT

這是一款在地下論壇公開銷售的惡意語言模型,聲稱沒有任何道德限制。它基於開源模型架構,並在大量惡意軟件相關數據上訓練而成。用戶只需支付少量費用即可獲得使用權限。該模型最臭名昭著的用途是生成極具欺騙性的商業郵件入侵攻擊和釣魚郵件。

在加密貨幣領域,其典型濫用方式包括:

模型B:暗網內容分析工具

這是一個專門在暗網數據上訓練的語言模型,最初目的是幫助研究人員和執法機構更好地理解暗網生態、追蹤非法活動。然而,如果被不法分子獲取或利用類似技術訓練出無限制模型,可能帶來嚴重後果。

在加密領域的潛在濫用包括:

模型C:網路欺詐多功能助手

這是一款在暗網和黑客論壇銷售的高級模型,號稱功能更全面。其在加密領域的典型濫用方式包括:

模型D:無道德約束的AI助手

這是一個明確定位爲無道德限制的AI聊天機器人。在加密領域的潛在濫用包括:

平台E:低審查模型訪問門戶

這是一個提供多種語言模型訪問的平台,包括一些審查較少的版本。雖然其初衷是爲用戶提供探索AI能力的開放環境,但也可能被濫用於生成惡意內容。潛在風險包括:

結語

無限制語言模型的出現標志着網路安全面臨着更復雜、更具規模化和自動化能力的新型威脅。這不僅降低了攻擊門檻,還帶來了更隱蔽、更具欺騙性的風險。

面對這一挑戰,安全生態各方需要協同努力:

只有通過多方面的共同努力,我們才能在享受AI技術紅利的同時,有效應對其帶來的潛在風險,確保加密貨幣生態的健康發展。